スマートデジタルワークソリューション

知識の格差がなく

一人一人が

活躍できる社会へ

デジタル時代における仕事環境の変革に向けて

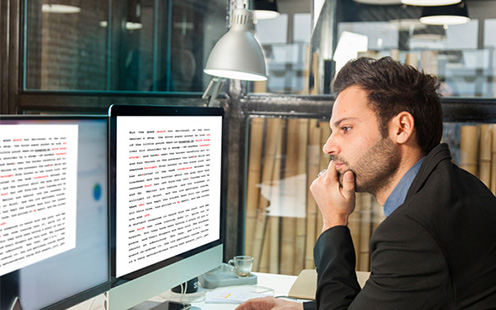

労働力が不足する中で、誰でも働ける環境を提供し、生産性を向上させるためには?

ノウハウや業務知識を

会話から引き出す

会話から引き出す

ノウハウや業務知識を

誰でも活用できるようにする

誰でも活用できるようにする

デジタルツールの定着を促し

生産性を向上させる

生産性を向上させる

これらを具体化するのが「スマートデジタルワークソリューション」です。

組織内のコミュニケーションと知識をデジタル化し、誰もが理解でき、再利用可能なナレッジへと転換、さらにナレッジを成長させる好循環を実現します。

組織の業務知識を好循環させる

スマートデジタルワークソリューションが実現する新たな働き方

コミュニケーションの活性化とデジタル化

暗黙知の言語化

会話することで個人の経験や勘といった暗黙知が言語化される

- レクチャ会

- 会議

デジタル化

言語化された情報を記録・デジタル化する

- 会議の発言のテキスト化

- 翻訳

- 作業記録の手順書化

- レクチャ会内容の文字起こし

ナレッジの整備と活用

データの蓄積・整備

デジタル化されたデータを使えるナレッジとして整備

- 類似事象のグループ化

- データの選別(ナレッジ化)

ナレッジ活用

整備されたナレッジを活用

ナレッジの活用状況を可視化

ナレッジの活用状況を可視化

- ナレッジ検索

- ダッシュボード

会話により言語化された暗黙知をデジタル化、蓄積し、組織全体のナレッジ活用を促進

スマートデジタルワークソリューション

デジタルコミュニケーション

コミュニケーションの活性化とデジタル化を促進する

ナレッジ活用基盤

ナレッジの整備と活用を支援する

デジタルアダプション

ユーザのデジタル利活用・定着を支援する

お知らせ

2023年4月20日

2023年3月20日

- スマートデジタルワークソリューションサイトを公開しました。

セミナー

現在、お知らせするセミナー情報はありません。

スマートデジタルワークソリューションに関するお問い合わせ・ご相談

Webでのお問い合わせ

当社はセキュリティ保護の観点からSSL技術を使用しております。