EUと米国の取り組みから学ぶ

日本の行政機関向けAI規制フレームワークの在り方 (上)

諸外国の主な取り組みを紹介した上で、日本の行政機関向けAI規制フレームワークの在り方を検討する。今回は官民双方のAI規制フレームワークとして、先行している欧州連合(EU)と米国の事例を紹介する。

はじめに

幅広い分野の質問に対し、市民が自然だと感じる回答を生成する人工知能(AI=Artificial Intelligence)である「ChatGPT」が急速に普及する中、AIの利活用策が脚光を浴びている。しかし「ChatGPT」の回答には事実と異なる場合があるほか、ユーザーはその回答に至るデータ処理のプロセスを理解できないというブラックボックス性を有するなど、リスクも指摘されている。このためAIをどのように規制し、リスク管理していくかについても注目されている。

AIの利活用は民間企業だけでなく、行政機関でも始まっている。民間企業に比べ、行政機関にはより強い説明能力が求められるため、AI規制の枠組み(AI規制フレームワーク)を慎重に検討することが必要である。

本稿では2回にわたり、諸外国の主な取り組みを紹介した上で、日本の行政機関向けAI規制フレームワークの在り方を検討する。今回は官民双方のAI規制フレームワークとして、先行している欧州連合(EU)と米国の事例を紹介する。

1.行政機関向けのフレームワークの位置付け

「ChatGPT」は、2022年11月に米国の「OpenAI」社がリリースした生成AIのアプリである。史上最も急速に普及している消費者向けアプリと位置付けられている一方、正確性やブラックボックス性を巡るリスクが指摘されている。

AIの利活用と規制の在り方が注目される中、23年4月に群馬県高崎市で開催された先進7カ国(G7)デジタル・技術相会合は、市民がAIのデータ処理プロセスを理解し、安心して利活用できる「信頼できるAI」の普及について合意する一方、AI規制フレームワークの検討は今後の課題とされた。

日本においては、政府の統合イノベーション戦略推進会議が22年4月に決定した「AI戦略2022」で、「政府におけるAI利活用の推進」が打ち出されている。また河野太郎デジタル相は、各府省においてAIの利活用を進めて業務を効率化し、働き方改革の実現を目指すとしている。

しかし行政機関は民間企業と異なり、市民が選択することの難しい行政サービスを提供しており、市民に対して民間企業より強い説明能力が求められる。このため行政機関はAIのリスクを確実に管理できるよう、AI規制フレームワークを慎重に検討することが必要である。

2.諸外国の官民向けフレームワークの概要

(1) EU

① GDPR

「一般データ保護規則(GDPR=General Data Protection Regulation)」は、18年5月にEUで施行された個人データの取り扱いと移転に関する規則である。EUに拠点を有していたり、サービスを提供したりする日本企業も対象となっている。日本は19年、EUから個人データを移転できる十分性認定を受けている。

GDPRに違反した場合の制裁金の規模は、最高で2000万ユーロ(約28億円。1ユーロ=140円で換算)もしくは全世界年間売上高の4%のうち、どちらか高い金額とされており、EUでビジネスを展開する日本企業に影響力の強い規則となっている。

GDPRはAIによる「意思決定の自動化」と、個人データを自動的に取り扱う「プロファイリング」に注目している。プロファイリングを含む自動化された意思決定の例としては、自動車の制限速度違反においてAIがドライバーの運転習慣のデータを収集し、最近の交通違反歴といった他の事項を考慮して罰金の額を変えることなどが挙げられる。

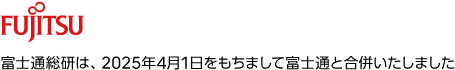

GDPRでは、このような自動車の制限速度違反など、プロファイリングを含む自動化された意思決定について、「ユーザーに法的効果が発生、または重大な影響がある」場合で、かつ「人の判断が介在しない」という「完全自動意思決定」は、原則禁止となっている(図表1)。

このためGDPRは、AIのリスクをもたらす「インパクト」や、AIの「ブラックボックス性」などに注目し、規制フレームワークを検討していると考えられる。

図表1:GDPRのプロファイリングを含む自動化された意思決定に関する規制

資料:「Regulation (EU) 2016/679 of the European Parliament and of the Council of 27 April 2016 on the Protection of Natural Persons with Regard to the Processing of Personal Data and on the Free Movement of Such Data, and Repealing Directive 95/46/EC (General Data Protection Regulation)」(EU/2016年)・「Guidelines on Automated Individual Decision-Making and Profiling for the Purposes of Regulation」(第29条作業部会/2018年)より作成

② AI規制(案)・AI規制フレームワーク

EUの執行機関である欧州委員会は、21年に「人工知能に関する整合的規則(人工知能法)の制定および関連法令の改正に関する欧州議会および理事会による規則案(Proposal for a Regulation of the European Parliament and of the Council Laying Down Harmonised Rules on Artificial Intelligence 〈Artificial Intelligence Act〉 and Amending Certain Union Legislative Acts)」(AI規制〈案〉)を公表している。

これはAIに関する世界初の規制であるほか、対象がEU域内だけでなく、AIをEUに提供する日本企業など、EU域外のプロバイダーも対象としており、世界的に注目されている。22年下半期からの移行期間を経て、最短で24年下半期に施行される予定である。

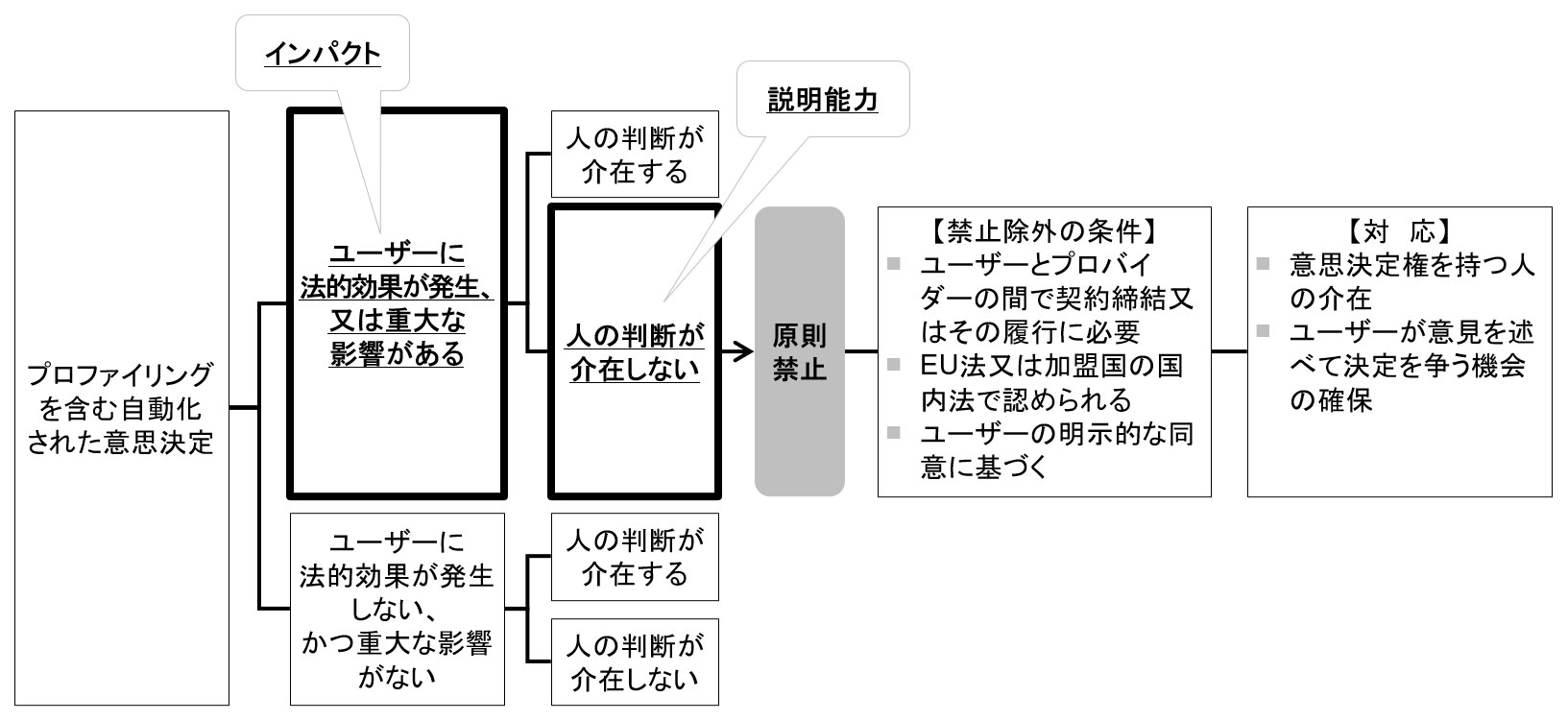

AI規制(案)に基づくEUのAI規制フレームワークは、AIのリスクを四つに分類し、その大きさに応じたリスク軽減対策を求める「リスク・ベース・アプローチ」となっている(図表2)。欧州委へのヒアリング調査によると、EUのAI規制フレームワークにおいては、基本的権利として「健康」と「安全」に注目し、AIのリスクを分類している。このうち「健康」では、暴力につながる人種差別やプライバシーなどが重要とされている。

なお欧州委は、行政機関は民間企業と比べて規制が強いほか、義務が多く、AIを登録する必要があることから、EUのAI規制フレームワークへの対応については民間企業ほど心配していない。

EUの規制フレームワークは、AIの「インパクト」のほか、限定的なリスクのAIについてはプロバイダーにユーザーへの通知を求めているため、「ブラックボックス性」などに注目して検討されていると考えられる。

図表2:リスク・ベース・アプローチによるEUのAI規制フレームワーク

資料:「Proposal for a Regulation of the European Parliament and of the Council Laying Down Harmonised Rules on Artificial Intelligence (Artificial intelligence Act) and Amending Certain Legislative Acts」(欧州委員会/2021年)より作成

(2) 米国

米大統領府の科学技術政策局(OSTP=Office of Science and Technology Policy)は、22年10月に「AI権利章典に向けた青写真(Blueprint for an AI Bill of Rights: A Vision for Protecting Our Civil Rights in the Algorithmic Age)」を公表している。

ここでは、AIはがんの早期発見や農業の収穫量の増加、学習などについてイノベーションをもたらしている一方、機会の平等が低下したり、不適切なバイアスが生じたりして、透明性やアカウンタビリティー(説明責任)、プライバシーが失われているとしている。

大統領府は、青写真と同時に「ファクトシート(Fact Sheet: Biden-Harris Administration Announces Key Actions to Advance Tech Accountability and Protect the Rights of the American Public)」も打ち出している。

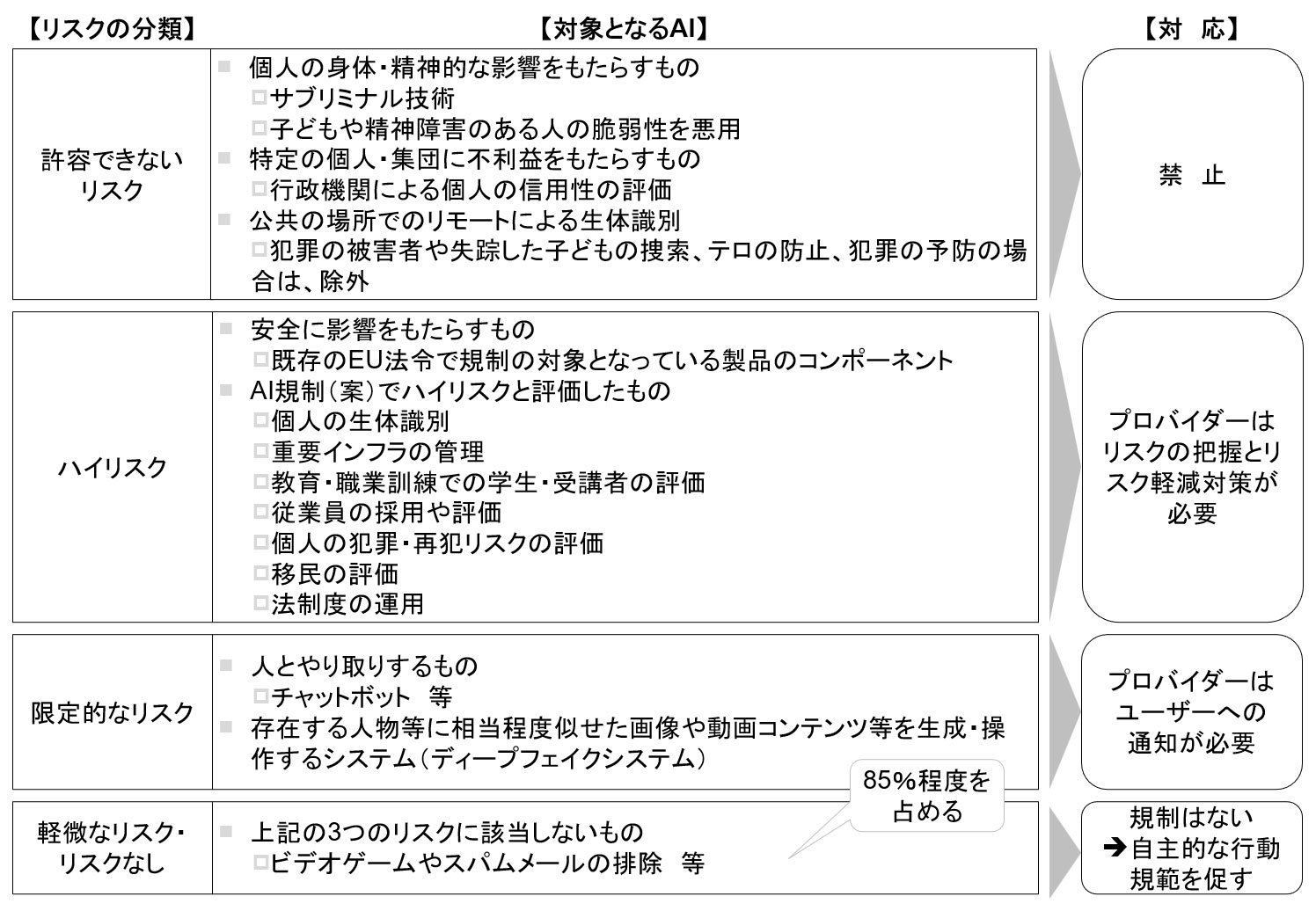

シートは、AIに関する五つの政府横断的な取り組みにおいて、労働者や消費者、学生・教育者、患者・医療関係者、住宅へのアクセス、民主的な価値観、研究者・起業家に関する保護を示している(図表3)。

青写真は、大手テック企業への規制を強化する米国の方針に基づくものであり、市民のAIに対する不安の払拭に取り組みながら、大手テック企業に説明責任を求めている。このため「ブラックボックス性」「説明責任」などに注目していると考えられる。

図表3:AIに関する5つの保護の政府横断的な取組

資料:「Fact Sheet: Biden-Harris Administration Announces Key Actions to Advance Tech Accountability and Protect the Rights of the American Public」(OSTP/2022年10月)より作成

3.まとめ──次回に向けて

今回は、諸外国における官民向けAI規制フレームワークの例として、EUのGDPRとAI規制(案)・AI規制フレームワーク、米国のAI権利章典に向けた青写真を紹介した。それらを整理した結果、「インパクト」「ブラックボックス性」「説明責任」などが注目されていることが分かった。

EUのGDPRは、AIによる意思決定の自動化とプロファイリングに注目している。米国の青写真は、AIのリスクから市民を保護する政府横断的な取り組みなどを示している。一方でEUのAI規制フレームワークは、リスク・ベース・アプローチに基づく包括的な取り組みと位置付けられる。

このため、日本の行政機関向けAI規制フレームワークの検討に当たっては、包括的なEUのフレームワークを参考にしながら「インパクト」「ブラックボックス性」「説明責任」などに注目することが適切であると考えられる。

次回は、諸外国の行政機関向けAI規制フレームワークの事例として、カナダと英国の取り組みを紹介し、日本におけるその在り方を検討する。

- (注1)「時事通信社発行『地方行政』 2023年6月29日号に掲載されたものです。

- (注2)本記事・画像・写真を無断で転載することを固く禁じます。

坂野 成俊(さかの なるとし)

Sakano, Narutoshi

公共政策研究センター長

専門分野

- 日本企業の海外展開戦略

- 環境・経済分析

- 自治体経営

1999年慶応義塾大学経済学部卒業、2001年一橋大学経済学研究科修了、同年富士通総研入社。主にICT・交通分野など日本企業の海外展開の促進に関する政策や経済動向、環境政策等に関する調査研究業務のほか、地方自治体の各種計画策定等に関するコンサルティング業務に従事。

『Smart City Emergence 1st Edition』(Elsevier/2019年7月)で「The Smart City of Nara, Japan」や、『運輸と経済(2019年10月)』(交通経済研究所)で「民間力を活用したメンテナンスについて~英国からの教訓~」等を執筆。日本規格協会で「日ASEANコールドチェーン物流ガイドラインのJSA-S化(2019年度)」の委員等も務める。

-