サステナブルな社会の実現に不可欠なAI倫理

富士通インドの人工知能ユニットの技術責任者であり、認定トップエンジニアGFDEの1人、Amitkumar Shrivastavaが、AIに興味を持ったのは彼が大学1年の時でした。

「研究室で謎めいたUnix(※1)の画面を見た途端、私はすぐに夢中になりました。そして初めて手に入れたデスクトップパソコンにUnixのOSの一種、OpenBSDをインストールしようとしたことが、すべての挑戦の始まりです。大がかりな解析を要する課題に取り組むなかでデータの記録やパターン解析に惹かれていきました。またチェスが好きだったということもあります。チェスのゲームにはAIの基本概念でもあるゲーム理論や意思決定の過程といったものが含まれていて、その分析に夢中になっていると、知らず知らずのうちに機械学習やAIの考え方が身についていたのです。」

- ※1 Unix:科学技術計算分野などで用いられるOSの一種

AIのエキスパートとなったAmitkumarは「AI倫理の確立無しに、サステナブルな社会を育むことは不可能です。」と強調します。「一方で、倫理的問題が起きないようにするため、AIのすべての処理を監視し、またその結論が適切かどうかを都度判断するような方法は現実的ではありません。」とも指摘します。

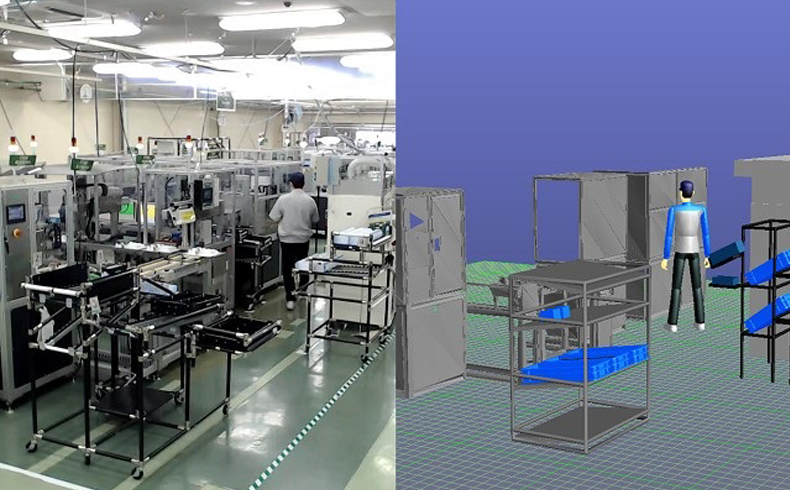

Amitkumarのインドチームと、富士通研究所のコンバージング研究チームが、共同で開発したのが最先端AIである行動認識技術「Actlyzerデジタルツイン連携技術」です。これは、製造業などの現場に設置したカメラの映像から人の行動を3次元上で正確に捉えて動作を解析するもので、仮想ラインシミュレータ上に人の行動のデジタルツインを簡単・高精度に実現できます。すでに一部の製造業者の工場内で、機械周辺の従業員の動きのモニターに活用されており、事業者は、生産性や安全対策を向上させるための作業パターン最適化が可能になっています。

また、潜在的に危険な行動の特定により、事故の未然防止にも本技術は活用できます。Amitkumarは「自分のチームが、作業者の安全やスマート工場の実現に貢献できたことが嬉しい」と話しています。

Actlyzerデジタルツイン連携技術による3D行動認識の様子

Actlyzerデジタルツイン連携技術による3D行動認識の様子

さらにAmitkumarのチームは、他の業種向けにもActlyzerの活用を広げています。例えば小売業向けには、棚の商品の在庫切れを検出する機能などを追加して、在庫切れを回避することで、ビジネスへの影響を最小化すること等に役立てています。また、店舗で購入を決定する際の顧客の行動を分析することで、店舗オーナーに重要なインサイトを提供することも可能です。

「Actlyzerの最も優れた点は、顔データのような個人情報を取得することなく、お客様の行動を分析できることです。これは、顧客のプライバシーを重視する小売企業にとって大きなメリットとなるはずです。」と、AmitkumarはActlyzerにおけるデータプライバシー保護とセキュリティプロトコル順守の取り組みを強調します。

安心・安全なAIを目指して

Amitkumarは、多くの利点がある一方で、AIが持つ潜在的なリスクについても警鐘を鳴らしています。

彼は消費者の間でAIに対する懸念があることも理解しています。AIが生活者の監視の強化に繋がったり、より巧妙な犯罪を誘発したりする恐れを懸念する声も聞かれるからです。そのため「AIが諸刃の剣であることを心に留めておくことが重要であり、どんな新しい技術もメリットをもたらすだけでなく、欠点や不確実性があることを認識することが大切です」と語ります。だからこそ、技術のオープンアクセスを提供する際には、常に倫理的な影響を考慮する必要があるのだとAmitkumarは自身の見解を述べます。

「責任ある倫理的なAIを実現するためには、データの質と多様性を向上させる必要があります。研究者、開発者、政策立案者が、AI倫理について徹底的に検討し、問題の対処を話し合い、協力しなければなりません。また、AIをめぐる明確な基準や政策などを確立し、定期的に見直すことも必要です。さらに、その能力と限界について一般の人々を教育することも重要です。」

同氏はまた、機械学習モデルをサイバー攻撃から保護するために、あらゆる手段を講じることが重要だと訴えます。

AI人材の育成で目指す豊かな社会

Amitkumarとチームメンバーは、お客様のビジネスの変革支援と同様に、社会への貢献にも力を注いできました。彼は、より持続可能な未来の実現に向けたAI開発には、エンジニアに対して総合的な教育を行うことが不可欠だと考えています。とりわけ強調するのは、コンピュータサイエンス、数学、統計学を含む技術的素養を持つエンジニア育成の必要性です。また、社内外のパートナーと効果的に仕事をするうえで、コラボレーションとコミュニケーションのスキルも重要であるといいます。

さらにAmitkumarは、経済的・社会的な幸福を実現するために、新たなAI人材のスキルアップにも、より注力していきたいと話します。具体的には、次世代を担う子どもたち向けのパーソナライズされたeラーニングシステムの構築や、若い世代に対するAI技術関連のトレーニングにも積極的に取り組んでいます。

Amitkumarは、最後に、富士通のAIリーダーの一人として、AI技術がSDGsを実現し、世界をすべての人々にとってより良い場所なるようイノベーションを推進していきたいと締めくくりました。

Amitkumar Shrivastava

GFDE

富士通インド、テクニカルヘッド-AI