可精确检测出表情细微变化的AI面部表情识别技术

本技术介绍参考了以下链接

English

2020年6月12日

可精确检测出表情细微变化的AI面部表情识别技术

在远程监控中,可检测对方因心情变化表现出的细微的表情变化

株式会社富士通研究所(注1)(以下简称:富士通研究所)、Fujitsu Laboratories of America Inc.(注2)(以下简称:美国富士通研究所)此次与Carnegie Mellon University School of Computer Science(注3)(以下简称:卡耐基梅隆大学计算机科学学院)合作开发了一种AI表情识别技术,可精确检测出面部表情的细微变化。

开发背景

近年来,通过图像捕捉面部表情变化,读取人类情感的技术备受关注。到目前为止,已开发的技术主要用于检测面部表情的明显变化,如人在喜怒哀乐时嘴角、眼角的大幅度动作变化等。此类技术已在多个领域得到了实际应用,比如自动提取视频中的精彩场景、根据人类情感变化改变动作的机器人等。今后,面部表情识别技术有望在多种场景下得到更广泛应用,如在医疗领域对患者状态进行观察、在市场营销领域分析顾客对商品的反应等。

课题

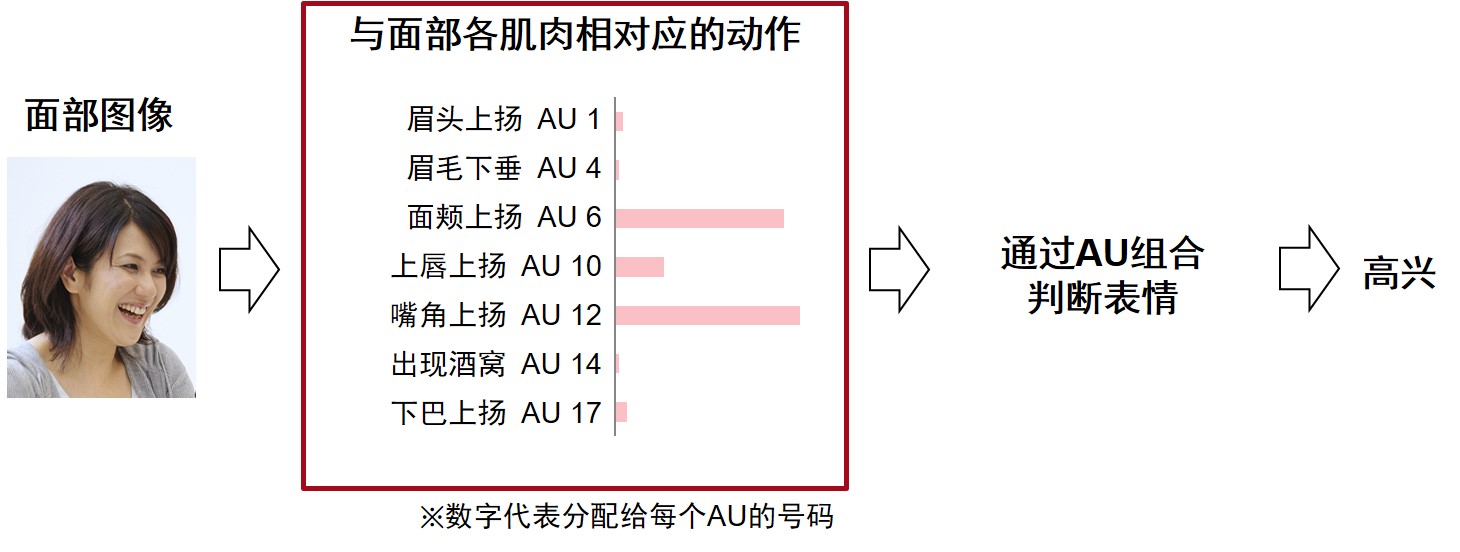

为了更加精确地读取人类的情感,捕捉与情绪(理解、困惑或感到压力等)相关的面部表情的细微变化是十分重要的。近年来,为了实现这一点,Action Unit(以下简称:AU)的应用得到了推广,并被用于心理学研究及动画生成等多种领域。AU基于解剖学的原理知识,被定义为与面部各块肌肉相对应的运动单位。根据眉毛下垂、面颊上扬等人类面部肌肉的运动规律,AU大约被分为30种。通过组合这些AU,除喜怒哀乐之外,还可捕捉到细微的表情变化。AU检测通常使用的是深度学习技术,因此需要准备用于深度学习的大量学习数据。特别在实际环境中,由于摄像头是以不同角度、大小、位置进行面部拍摄的,所需学习数据量庞大,因此很难针对每个状态准备相应的学习数据,而这将对检测精度造成影响。

图1. AU与表情的关系原理图

开发的技术

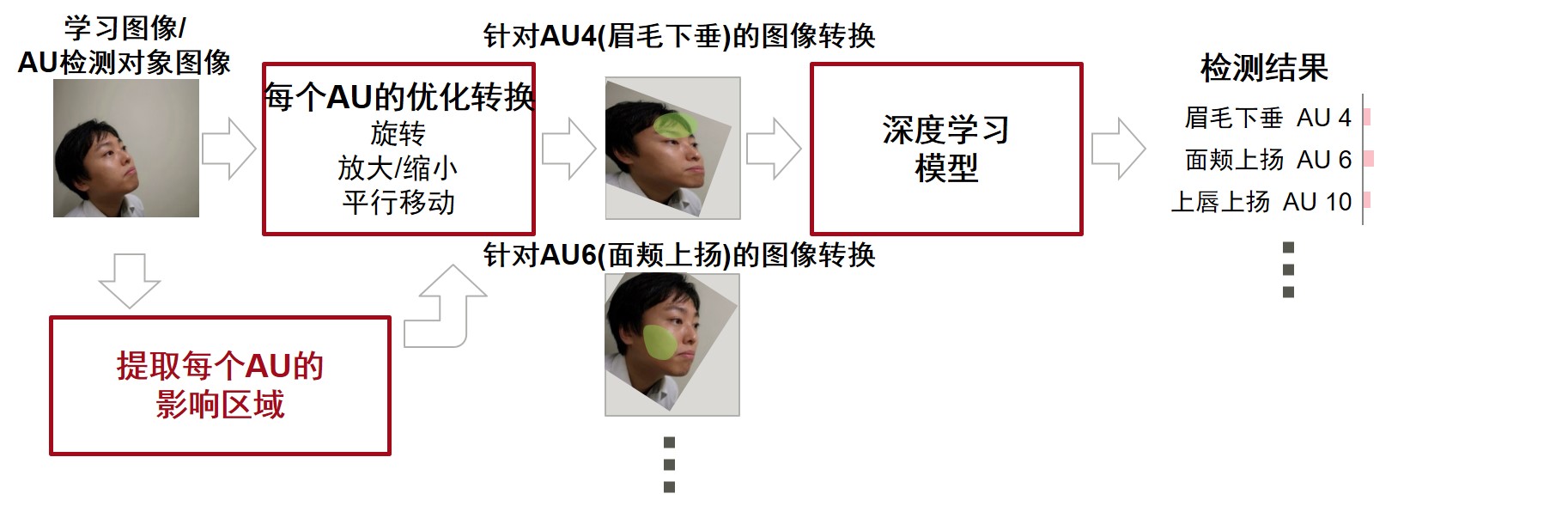

此次,富士通研究所与美国富士通研究所,在和卡耐基梅隆大学计算机科学学院的共同研究中,开发了一种AI表情识别技术,通过对每个AU进行图像优化转换处理,即使学习数据数量有限也可实现高精度的AU检测。

- 通过对输入图像进行转换处理,使其接近从正面拍摄的面部基准图像,实现少量学习数据的AU检测

该技术将不同角度、大小、位置拍摄的人脸图像,进行旋转、放大/缩小、平行移动等转换处理,使其看起来更加接近从正面拍摄的面部基准图像。这样,无需针对各面部角度准备大量的学习数据,仅通过少量学习数据便可实现AU检测。

- 通过分析每个AU中影响AU检测的重要区域,实现高精度检测

在转换处理过程中,对图像中面部的多个特征点进行转换,使其接近正面面部基准图像中的特征点位置。但图像旋转、放大/缩小、平行移动的量取决于特征点设置在面部的位置。例如,如果将特征点设置在“眼睛周围”并进行旋转处理,眼睛周围的区域将接近于基准面部图像,但嘴等部分将偏离基准面部图像。

因此,针对拍摄的面部图像,我们分析了其中对AU检测有重要影响的区域,为了使该区域周围的特征点更接近于基准面部图像的特征点位置,需要对旋转、放大/缩小、平行移动的量进行调整。通过对每个AU的转换处理进行调整,可实现高精度的AU检测。

图2. 开发的技术

效果

针对表情数据集FERA2017(Facial Expression Recognition and Analysis Challenge 2017),该技术实现了81%的高检测精度。另外,与FERA2017的基准指标进行对比,结果显示,该技术比现有尖端技术具有更高精度。

今后

富士通研究所与美国富士通研究所,目标实现该技术在各应用场景的商业化落地,如远程会议支持、公司员工敬业度测量、司机驾驶状态监控等。